人工智能显示能力理解复杂的词的含义

在“通过镜子,”汉仆。达谱轻蔑地说,“当我使用一个词,它意味着我选择是什么意思——不多也不少。”爱丽丝回答说:“问题是你可以的话是否意味着很多不同的事情。”

什么单词的学习真正的意思是年龄老了。详细的人类思维必须解析web,灵活的信息和使用复杂的常识来理解它们的含义。

现在,一个新的问题出现了相关单词的意义:科学家们正在研究人工智能是否能模仿人类思维理解词人们做的方式。加州大学洛杉矶分校的研究人员的一项新研究,麻省理工学院和美国国立卫生研究院解决这个问题。

这篇发表在《华尔街日报》自然的人类行为报告说,人工智能系统确实可以学到非常复杂的单词含义,和科学家们发现了一个简单的技巧来提取复杂的知识。他们发现人工智能系统研究代表了词义的强烈的方式与人类的判断。

AI系统,作者调查了过去十年一直常用研究词义。它学会找出单词含义的“阅读”天文数字的内容在互联网上,包括数百亿的单词。

当词经常出现在一起,“表”和“椅子”,例如,系统学习,他们的意思是相关的。如果对单词出现在一起很少——就像“表”和“行星,”——他们学习有非常不同的含义。

这种方法似乎是一个逻辑起点,但考虑人类如何理解世界如果理解意义的唯一方法是计算频率单词出现的靠近彼此,没有与人交流的能力和我们的环境。

加州大学洛杉矶分校的心理学助理教授Idan空白和语言学研究的联合作者,研究人员说着手学习系统知道什么单词学习,什么样的“常识”。

在研究开始前,布兰克说,系统似乎有一个主要的限制:“系统而言,每两个字只有一个数值,表示他们是多么相似。”

相比之下,人类知识更详细和复杂得多。

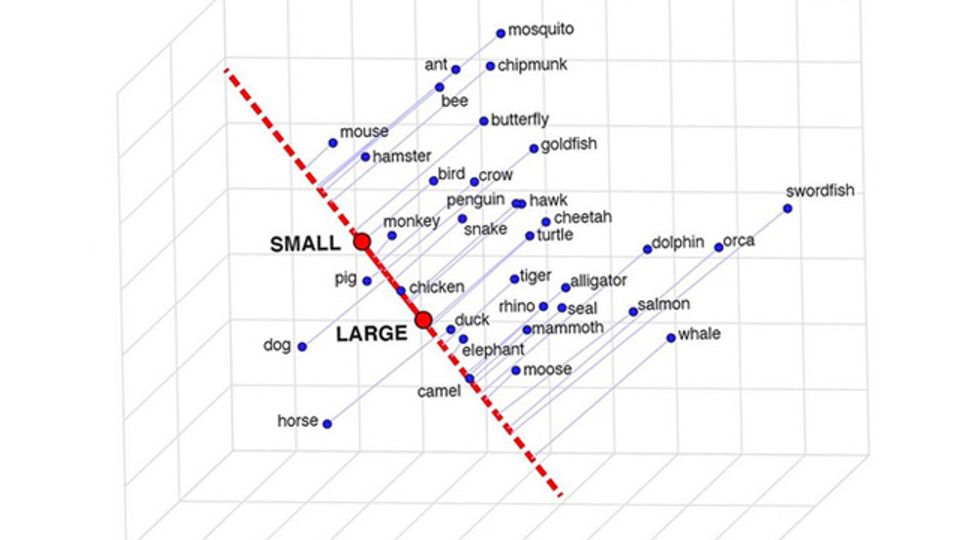

“考虑我们海豚和鳄鱼的知识空白。“当我们比较两个规模的大小,从“小”到“大”,他们是比较相似的。的情报,他们是不同的。危险对我们而言,规模从“安全”的危险,他们有很大的不同。所以一个词的意义取决于上下文。

“我们想问这个系统是否真的知道这些细微的差别,其相似的想法是否以同样的方式是灵活的人类。”

为了找到答案,作者开发了一种技术他们称之为“语义投射。”一位之间画一条线的模型的表示“大”和“小”例如,看到不同的动物落在这条线的表示。

使用这种方法,科学家们研究了52个单词组系统是否能学会某种意义——就像判断动物通过它们的大小或他们是多么危险的人类,或者美国天气或分类总体财富。

其他单词分组中有条款相关的服装、职业,体育,神话生物和名字。每个类别被分配多个上下文或尺寸,大小,危险,智力、年龄和速度,例如。

研究人员发现,在那些许多对象和环境中,他们的方法被证明是非常类似于人类的直觉。(做出比较,研究人员还要求群25人都做出类似的评估每个52字组。)

值得注意的是,该系统学会认为名字“贝蒂”和“乔治”类似的相对“老”,但他们代表了不同的性别。“举重”和“击剑”相似,通常发生在室内,但是不同的情报需要多少。

“这完全是这样一个漂亮的简单方法和直观,“空白说。”“大”和“小”之间的界限就像一个心理量表,我们把动物放在规模。”

布兰克说他真的没想到技术工作但很高兴当。

“原来,这远比我们想象的更聪明的机器学习系统;它包含了非常复杂的形式的知识,这种知识被组织在一个非常直观的结构,”他说。“只要跟踪哪些词共现彼此的语言,你可以学到很多关于世界。”

参考:大G,空白IA,佩雷拉F, Fedorenko大肠语义投影恢复丰富人类知识嵌入多个对象特性的词。Nat哼Behav。2022:1-13。doi:10.1038 / s41562 - 022 - 01316 - 8

本文从以下转载材料。注:材料可能是长度和内容的编辑。为进一步的信息,请联系引用源。